Deepfakes, ou quand les vidéos mentent

Risques sur Internet

Il ne faut pas croire tout ce que l’on voit sur Internet, même lorsqu’il s’agit d’une vidéo. Les deepfakes, soit des contenus falsifiés à l’aide de l’intelligence artificielle, sont désormais légion sur les réseaux sociaux et le web en général. Souvent, ils ont pour but de répandre de fausses informations. Et ils ne représentent pas juste un problème pour les stars et le monde politique.

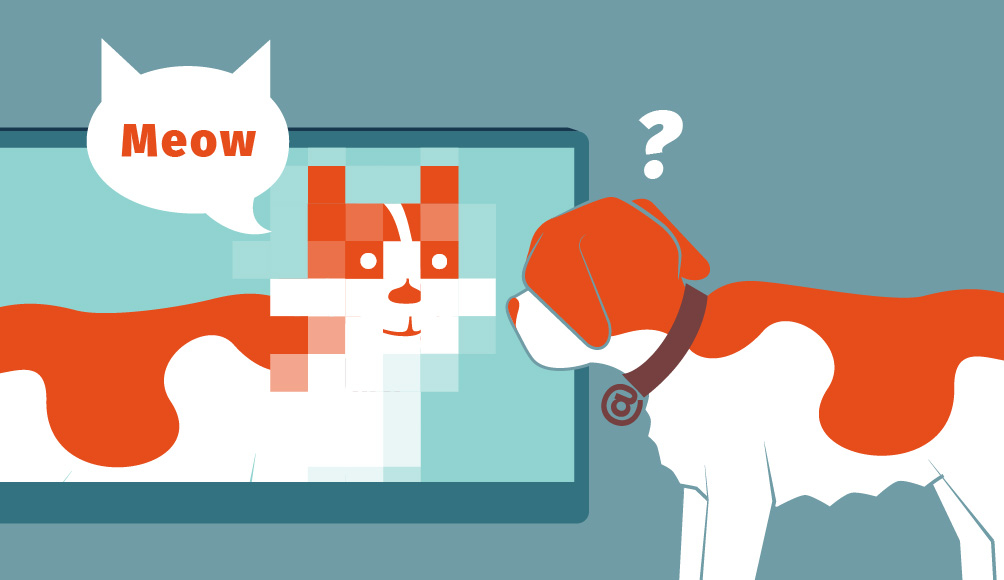

Lorsqu’on trouve un contenu en ligne qui semble à peine croyable, il s’agit certainement d’un deepfake. Ce terme vient de «deep learning» et de «fake», ou «faux» en anglais. Le deep learning est une forme d’intelligence artificielle (IA). Celle-ci «apprend» sur la base d’exemples et peut ensuite reproduire cet acquis. C’est exactement ce que font les deepfakes. Le système commence par exemple par apprendre à identifier le visage de quelqu’un. Puis, il est en mesure de l’intégrer dans une autre vidéo.

Les deepfakes peuvent prendre plusieurs formes:

- Remplacement d’un visage

- Remplacement des lèvres (pour donner l’impression que la personne prononce d’autres paroles)

- Imitation d’une voix

- Avatars numériques (voix et visages entièrement artificiels)

En soi, un deepfake n’est pas criminel. Il peut avoir des applications légales, par exemple:

- Productions cinématographiques et télévisées à des fins de divertissement (voir exemples ci-après)

- Utilisation à des fins artistiques ou satiriques

- Applications dans la recherche scientifique

- Intégration dans des solutions de vidéoconférence pour diminuer le besoin en bande passante

Mais attention, même si les deepfakes ne sont pas illégaux, ils peuvent tout de même contrevenir à certaines lois, notamment dans le domaine de la protection des données et du droit d’auteur. Ils sont d’ailleurs souvent utilisés à des fins douteuses ou illégales. En font partie:

- Pornographie: de très nombreux deepfakes sont de nature pornographique. Un visage, par exemple celui d’une personnalité politique ou d’une ou un ex-compagne ou compagnon, est ajouté à des contenus pornographiques.

- Fake news: diffusion de fausses informations, par exemple lors d’élections ou actuellement dans le contexte de la guerre en Ukraine.

- Arnaques au CEO: les deepfakes n’épargnent pas l’univers du management; les cybercriminels imitent par exemple la voix d’un CEO et tentent d’obtenir de l’argent par téléphone.

- Fausses candidatures: prudence lors des entretiens d’embauche en ligne. Les cybercriminels dissimulent leur identité pour essayer d’accéder à des données commerciales ou relatives à la clientèle.

- Chantage: les deepfakes permettent de créer des images ou des vidéos mettant prétendument en scène des personnes ayant un comportement illégal ou contraire aux mœurs.

Pour l’instant, le nombre de deepfakes utilisés à des fins criminelles reste faible, mais la technologie progresse à un rythme fulgurant. La puissance de traitement nécessaire diminue sans cesse alors que la qualité augmente. Il faut donc s’attendre à ce que les problèmes entourant les deepfakes aillent croissant.

Comment reconnaître les deepfakes

Un peu de bon sens peut aider à y voir clair. Quoi que l’on voie ou entende, seul ce qui peut être vérifié est vrai. En y regardant de près, les deepfakes sont identifiables, du moins à l’heure actuelle. Si vous pensez avoir affaire à l’un de ces montages, les points suivants pourront vous aider à démêler le vrai du faux.

- Bon sens: le comportement de la personne dans la vidéo a-t-il un sens? Avant de partager quoi que ce soit en ligne, mieux vaut en vérifier la véracité.

- Mouvements de la tête peu naturels: le visage semble souvent bouger différemment du reste du corps, ce qui a un effet étrange ou manquant de naturel («vallée de l’étrange»).

- Y regarder de plus près: parfois, les mouvements rapides de la tête se perdent au montage vidéo. Par exemple, on entend un toussotement ou un éternuement, mais sans voir le mouvement correspondant du visage.

- Détails: les deepfakes étant générés automatiquement, on constate souvent de petites erreurs, par exemple au niveau des lunettes, des bijoux ou de la réflexion de la lumière.

- Frame by frame: regarder une vidéo image après image permet d’identifier bien plus vite les disparités.

- Tourner la tête: en cas de doute lors d’une vidéoconférence, demandez à votre interlocuteur de tourner la tête de côté. Le deepfake ne saura alors pas où implanter le visage dans l’image.

- Contrôler les faits: une vidéo potentiellement fausse se trouve-t-elle aussi sur des sites de confiance? Ou obtient-on la même vidéo, mais non truquée, en googlant sa description?

Plusieurs hautes écoles annoncent d’ores et déjà être en mesure de détecter automatiquement les deepfakes. Par exemple, une équipe de l’Information Sciences Institute de l’University of Southern California reconnaît 96% des deepfakes.

Et comment éviter d’être victime d’un deepfake?

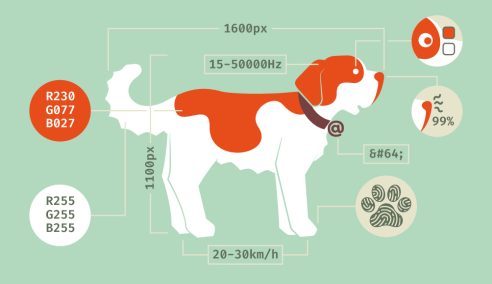

Un deepfake convaincant exige une grande quantité de données audio et vidéo de la personne concernée. Aucune IA n’est en mesure d’imiter la voix ou le visage d’une personne si elle ne dispose pas de suffisamment de données. Pensez donc à limiter votre présence en ligne si cette thématique vous inquiète.

En savoir plus

YouTube

Les deepfakes et Star WarsYouTube

Vidéo «The Heart Part 5» de Kendrick LamarUSC Information Sciences Institute, USA

Travaux de recherche sur l’identification des deepfakes grâce à l’IACornell University

Méthode d’identification des deepfakes au moyen de la réflexion de la lumière